图片

图片

从AutoGPT的横空出世到斯坦福“西部世界”的惊艳亮相,自主智能体(Autonomous Agents)正以惊人的速度重塑我们对AI的认知。如果说ChatGPT只是一个博学的“大脑”,那么Agent就是给这个大脑装上了手脚和感官,让它真正具备了像人一样在物理或数字世界中行动的能力。

ArXiv URL:http://arxiv.org/abs/2308.11432v7

然而,面对每天如雨后春笋般涌现的新论文和新架构,你是否感到眼花缭乱?究竟什么样的系统才能被称为Agent?它们是如何记忆、规划并执行任务的?

最近,来自中国人民大学的研究团队发布了一篇重磅综述,不仅系统地梳理了基于大语言模型的自主智能体(LLM-based Autonomous Agents)领域,更提出了一个通用的统一架构框架。这篇文章就像一张高精度的地图,为我们指明了通往通用人工智能(AGI)的潜在路径。

为什么要从LLM出发构建Agent?

在LLM爆发之前,学术界和工业界其实研究Agent很久了。但那时的Agent大多是“井底之蛙”——它们在孤立、受限的环境中(比如简单的游戏环境)通过强化学习训练,知识匮乏,很难做出像人类那样复杂的决策。

LLM的出现改变了游戏规则。凭借海量的网络知识和强大的泛化能力,LLM不仅能理解自然语言,更展现出了惊人的推理和规划潜力。这让研究人员意识到:与其从零训练一个大脑,不如直接让LLM充当Agent的“中央控制器”。

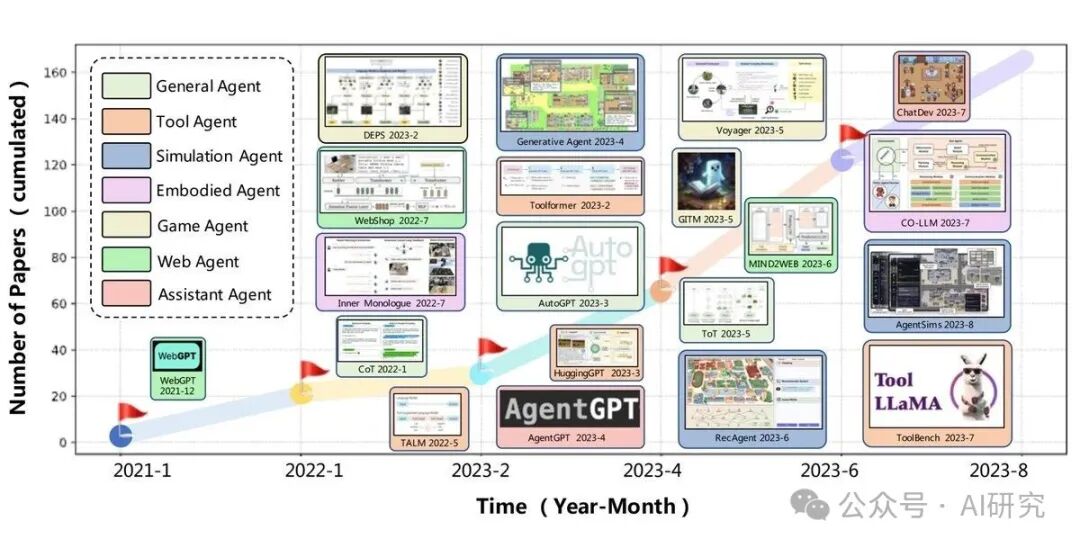

如图1所示,这一领域的论文数量在2023年呈现了井喷式的增长。

Refer to caption

Refer to caption

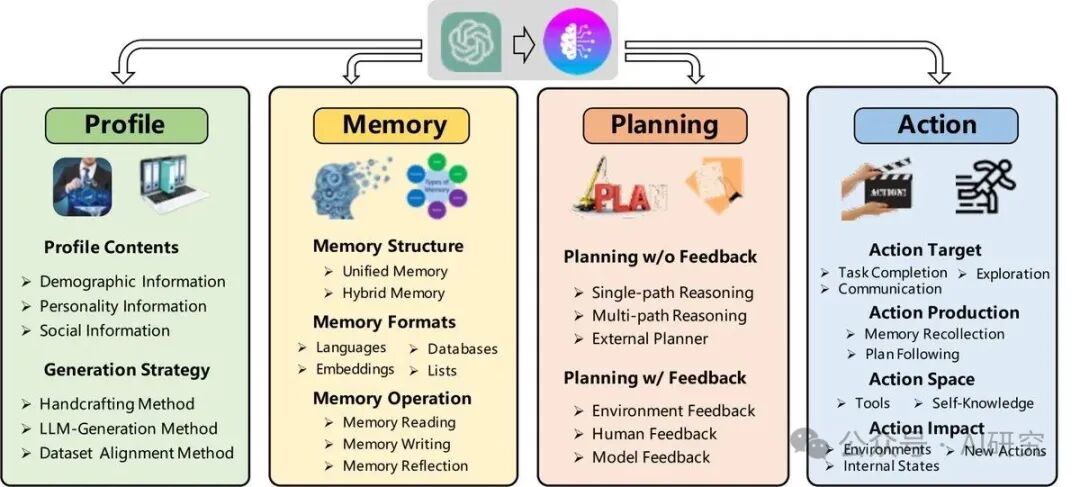

核心解密:Agent的统一架构框架

为了理清纷繁复杂的研究,论文提出了一个通用的Agent架构框架。这个框架将一个合格的Agent拆解为四个核心模块:配置(Profiling)、记忆(Memory)、规划(Planning)和行动(Action)。

Refer to caption

Refer to caption

这就好比一个人类员工:他首先要有职业身份(配置),然后要能记住工作经验(记忆),接到任务后要懂得拆解步骤(规划),最后动手执行(行动)。

1. 配置模块(Profiling):我是谁?

Agent不仅仅是一个问答机器,它通常需要扮演特定的角色,比如程序员、教师或心理咨询师。配置模块的作用就是定义Agent的“人设”。

目前主要有两种构建人设的方法:

- • 手工制作:直接在Prompt中写明“你是一个资深Python工程师”。

- • 数据集对齐(Dataset Alignment):利用真实世界的数据集(如人口调查数据)来生成Agent的背景信息(年龄、性别、性格等)。这种方法能让Agent的行为更贴近真实人类,非常适合用于社会科学模拟。

2. 记忆模块(Memory):经验的积累与反思

这是Agent与传统LLM最大的区别之一。为了像人一样自我进化,Agent必须具备记忆能力。

该综述将记忆结构类比为人类的认知过程:

- • 短期记忆:对应LLM的上下文窗口(Context Window),处理当前的感知信息。

- • 长期记忆:对应外部向量数据库,用于存储长期的经验和知识,随时可以检索。

更有趣的是记忆反思(Memory Reflection)机制。就像人类会“吾日三省吾身”,Agent不仅要记录流水账,还需要从低级的日常记忆中提炼出高级的见解。例如,从“Klaus正在写论文”、“Klaus在查资料”这些琐碎记忆中,Agent应该能总结出“Klaus是一个专注于学术研究的人”这一高级认知。

在检索记忆时,通常遵循以下公式,综合考虑三个因素:

即:新近性(Recency)、相关性(Relevance)和重要性(Importance)。

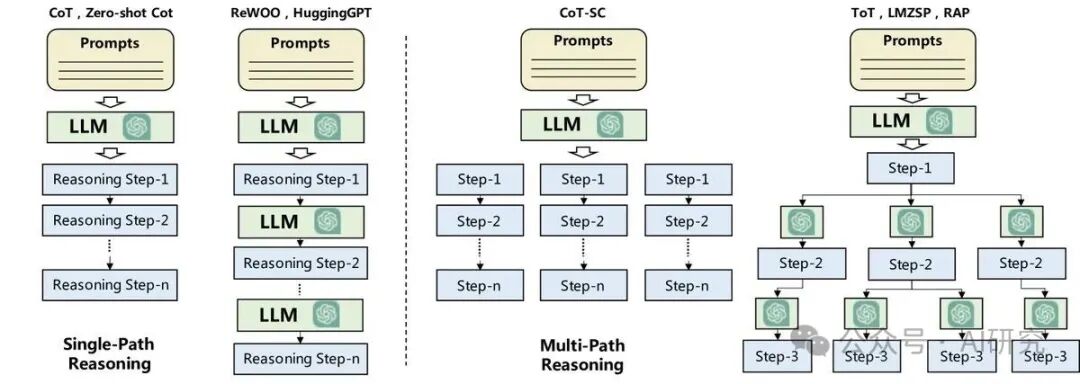

3. 规划模块(Planning):三思而后行

面对复杂任务,人类会将其拆解为子任务。Agent的规划模块正是赋予LLM这种能力。

目前的规划策略主要分为两类(如图3所示):

- • 单路径推理(Single-path Reasoning):如著名的思维链(Chain of Thought, CoT),一步步线性推导。

- • 多路径推理(Multi-path Reasoning):如思维树(Tree of Thoughts, ToT),在每一步生成多个可能的想法,并评估哪条路径最优,甚至可以回溯。这更接近人类在面临难题时的反复推敲过程。

此外,带反馈的规划至关重要。Agent不能只是一股脑地生成计划,还需要根据环境反馈(比如代码运行报错了)来修正计划,这被称为“环境反馈”或“自我修正”。

Refer to caption

Refer to caption

4. 行动模块(Action):从数字到物理

最后,Agent需要将决策转化为行动。这不仅包括输出文本,还包括使用工具(如计算器、搜索引擎)甚至控制机器人手臂。通过API调用或物理接口,LLM Agent的手伸向了现实世界。

总结与展望

这篇综述不仅为我们拆解了LLM Agent的内部构造,还展示了其在社会科学(如模拟社会演化)、自然科学(如辅助药物研发)和工程领域的广阔应用前景。

虽然目前的Agent还面临着上下文长度限制、幻觉问题以及多Agent协作效率等挑战,但正如文中所言,基于LLM的自主智能体已经让我们瞥见了通用人工智能(AGI)的曙光。它们不再是被动等待指令的工具,而是正在进化为能够感知、思考并改变世界的伙伴。

对于想要深入这一领域的开发者和研究者来说,理解这个“配置-记忆-规划-行动”的统一架构,是构建下一代超级应用的第一步。

文章来自:51CTO