开篇:爆火的 OpenClaw,为啥一晚上耗光几千万 token?

最近这段时间,OpenClaw(大家常叫它“龙虾”)爆火,身边不少人跟风部署使用,却被一个问题搞懵了——明明就跑了一晚上的自动化任务,后台一看,居然消耗了几千万 token,有的甚至直接耗空了 API 额度。要搞懂这个问题,咱们先从最基础的开始:大模型时代里,token 到底是什么?

一、大白话讲 token:AI 处理语言的“乐高积木”

先给大家说个大白话,不用记复杂术语:咱们平时和 AI 聊天、让 AI 做事,AI 其实看不懂完整的句子,它得先把咱们说的话、要处理的内容,拆成一个个“最小的有意义碎片”,这个碎片,就是 token。就像咱们拼乐高,再复杂的造型,都是用一个个小积木拼出来的,token 就是 AI 处理语言的“乐高积木”。

这里得简单说下大模型的基础逻辑,不然没法理解 token 的作用。所谓大模型,就是一个能理解、生成人类语言,还能完成复杂任务的“智能大脑”,比如 ChatGPT、Kimi、通义千问,还有 OpenClaw 背后用到的各类模型,都属于这类。但这个“大脑”有个特点,它不认识完整的字词,只能识别被拆分后的 token——比如“今天天气真好”,可能会被拆成“今、天、天、气、真、好”六个 token;英文单词“unhappiness”,会被拆成“un、happi、ness”三个 token,标点符号、空格,甚至 emoji,都可能是一个独立的 token。

二、关键概念:输入 token、输出 token、缓存命中

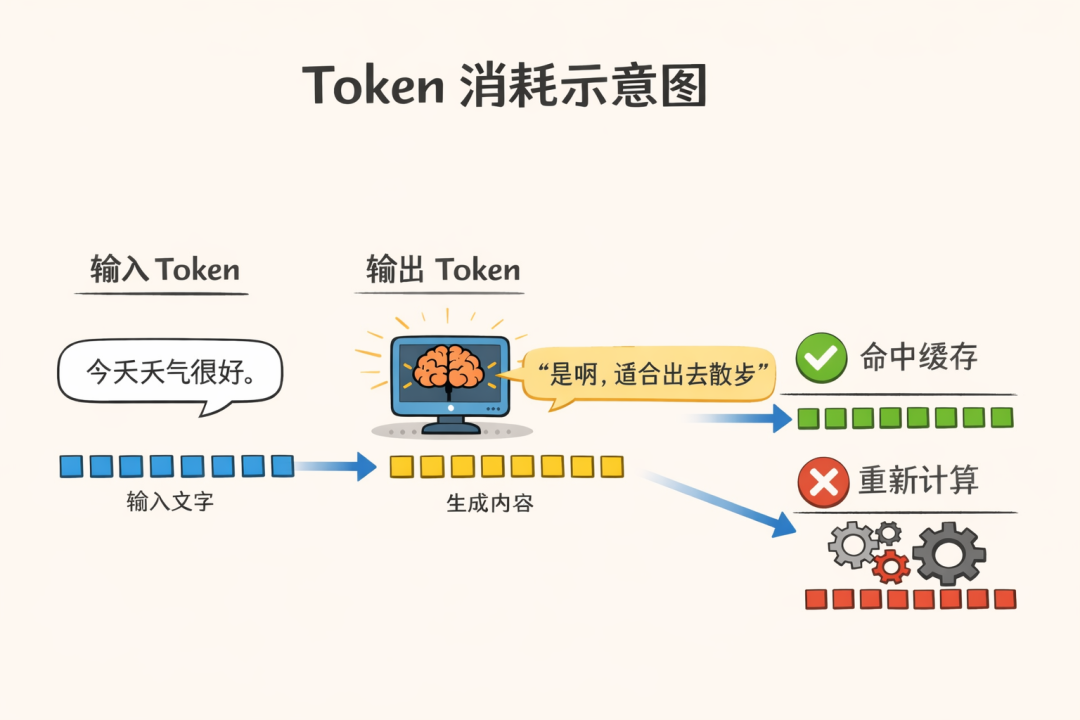

更直观一点说,token 就相当于 AI 的“话费流量”,你用 AI 做的任何事,都要消耗“流量”——这里就涉及到大家常听到的输入 token、输出 token、缓存命中,咱们一个个说,还是大白话,一听就懂。

先说说输入 token 和输出 token,这俩是最基础的,也是咱们消耗 token 的核心来源。输入 token,就是你发给 AI 的所有内容:比如你让 OpenClaw“爬取某平台 100 条商品数据并整理成表格”的指令、你粘贴给它的参考链接、你和它交互时说的每一句话,这些都属于输入 token,相当于你给 AI“发消息”,要消耗你的“流量”。而输出 token,就是 AI 给你的反馈:比如它爬取完数据后的表格内容、执行任务时的状态提示(“正在爬取第 35 条数据”)、遇到问题时的报错,这些 AI 生成的内容,都属于输出 token,相当于 AI“回消息”,同样要消耗“流量”。而且通常输出 token 比输入 token 消耗多,因为 AI 生成内容的计算量,比单纯识别你输入的内容要大得多。

在说说缓存命中,这个就相当于“省流量”的技巧,和咱们手机缓存图片、视频一样,能减少 token 消耗。简单说,就是 AI 会把你之前执行过的任务、输入过的内容、生成过的结果,暂时存起来(这就是缓存)。下次你再执行相同或相似的任务时,AI 不用重新计算、重新生成内容,直接从缓存里调取之前的结果,这就是缓存命中。缓存命中的时候,AI 几乎不消耗新的 token,或者只消耗很少的 token;反之,如果没有缓存命中,AI 就要从头开始处理,token 消耗就会特别多。

举个 OpenClaw 的实际场景更易理解:你让它爬取某固定网页的内容,第一次爬取需要消耗大量 token;如果过半小时你再让它爬取同一个网页,且网页内容没变化,AI 就会触发缓存命中,几乎不耗 token。但 OpenClaw 的任务大多是动态的——比如爬取不同商品、分析不同时段的日志,缓存命中的概率很低,这也是它费 token 的一个小原因。

图片

图片

三、核心疑问:OpenClaw 为什么这么费 token?

OpenClaw 费 token 的核心原因,和它的定位息息相关——它和咱们平时用的豆包、千问、元宝不一样,不是“你问一句、它答一句”的简单对话,而是一个能自主干活的“数字员工”,只要你给它一个指令,它就会自己拆解任务、一步步执行,每一步都在消耗 token,而且是持续不断地消耗。

给大家举个真实又有代入感的例子,比单纯说“整理文档”更直观:假设你是做自媒体的,让 OpenClaw 帮你“爬取某平台 100 条同领域爆款笔记,提取标题、点赞数、核心文案,筛选出点赞 1 万+的内容,再按文案风格分类整理成表格,最后生成一份爆款规律分析”。

这个看似简单的指令,OpenClaw 要做的步骤多到超乎想象:第一步,理解你的需求,拆解出“爬取数据 → 筛选数据 → 分类整理 → 生成分析”四个子任务(消耗输入+输出 token);第二步,打开浏览器,逐一访问 100 条笔记,每打开一条就提取信息,遇到网页加载失败还要重试,每一次访问、提取都要和大模型交互(持续消耗 token);第三步,筛选点赞 1 万+的内容,对比每条笔记的文案风格,进行分类(每一次筛选、分类都要消耗 token);第四步,生成表格和分析报告,表格里的每一行内容、分析里的每一句话,都是输出 token。

更关键的是,OpenClaw 是“自主循环”的,只要任务没完成,它就会一直执行,中间不会停。比如上面这个任务,全程可能要跑 2-3 小时,每一秒都在和背后的大模型交互,每一次交互都要消耗 token。要是你再让它同时爬取另一个平台的内容,多任务并行,token 消耗直接翻倍。

对比咱们平时用的 AI 聊天工具就很明显:你问“怎么写一篇爆款笔记”,AI 给你一个回复,对话结束,token 消耗就停了,一次也就几千个。但 OpenClaw 是“全天候在岗”,比如你让它跑一晚上的服务器日志分析,它会一直循环执行“读取日志 → 分析内容 → 标记异常 → 保存结果”的流程,一晚上下来,几千万 token 其实很正常。

四、token 消耗的核心逻辑,以及它到底有多费钱?

token 是大模型处理语言的最小单元,是 AI 做事的“流量”;OpenClaw 之所以费 token,核心就是它不是简单的对话 AI,而是能自主拆解、持续执行复杂任务的智能体,任务的每一步操作、每一次和大模型的交互,都会消耗 token,一晚上不停歇地运行,几千万 token 的消耗也就不足为奇了。

很多人吐槽 OpenClaw 费钱,到底有多费?咱们直接上数字,更有冲击力,尤其对比国产模型和海外模型,差距会更直观。目前主流大模型的 token 计费标准差异极大,咱们重点对比两款常用模型——国产 DeepSeek 最新 V3.2 模型和海外 Claude Sonnet 4.6 模型,而且只看输出 token(OpenClaw 主要消耗的就是输出 token):

- 国产 DeepSeek 的输出 token,每百万需 2 元人民币

- Claude Sonnet 4.6 的输出 token,每百万要 15 美元,按当前 1 美元 ≈6.90 元人民币的汇率折算,相当于每百万输出 token 要花 103.5 元人民币。

咱们还是按一晚上消耗 3000 万 token(主要是输出 token)算,差距直接拉满:

- 用国产 DeepSeek,费用仅需 3000 万 ÷100 万 ×2=60 元;

- 用 Claude Sonnet 4.6,费用直接涨到 3000 万 ÷100 万 ×103.5=3105 元。

同样一晚上的任务,两者费用相差 500 多倍!这还只是一晚上的消耗,要是连续跑几天,用 Claude Sonnet 4.6 的费用能轻松突破万元,而用 DeepSeek,几天下来也能达到上百块钱。

最后

Token不是什么神秘的东西,它就是大模型处理文字的计量单位。贵不贵,取决于你给它多少内容、让它做多少步骤、跑了多长时间。

OpenClaw 能力很强,但它不是免费的劳动力。用好了是效率神器,用歪了是碎钞机。理解token是怎么回事,才能真正把这类工具用得又好又省。

文章来自:51CTO