「小模型周」过去了 ,小模型的最新战场才刚刚开辟。

上周GPT-4o mini和Mistral NeMo二连发,「麻雀虽小,五脏俱全」的小模型成为业界大佬密切关注的新方向。

图片

图片

这么说来,难道大模型要失宠了? Scaling Law要失效了?

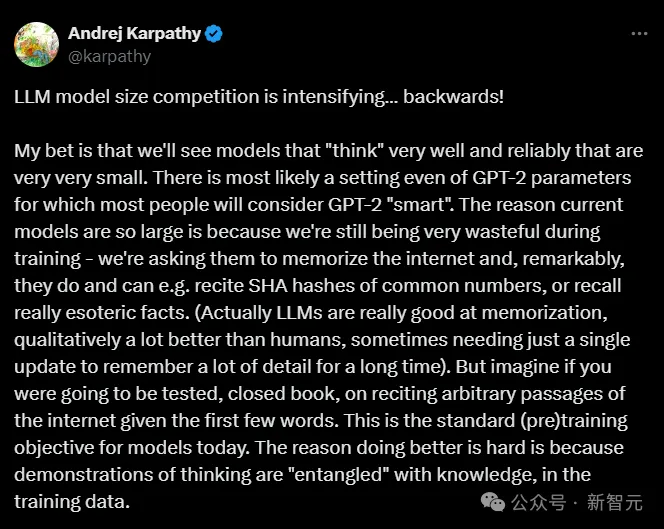

前OpenAI和特斯拉AI研究员Andrej Karpathy刚刚入局AI教育,「K老师」最近发表推文指导行业迷津,揭秘科技巨头纷纷转向小模型研发的背后新趋势:AI大模型的竞争即将逆转。

他预判,未来的模型将会更小,但仍然会变得更智能。

图片

图片

人工智能巨头公司和一些新晋独角兽,最近都发布了与其他同行相比更紧凑、更强大、更实惠的人工智能模型,最新的例子是OpenAI的GPT-4o mini。

Karpathy预测这一趋势将持续下去。他写道,「我敢打赌,我们会看到很多能够有效可靠思考的模型,而且体积非常小。」

小模型:站在巨人的肩膀上

在LLM发展的初期阶段,吞吐更多数据,把模型往大了做是必然的趋势。这主要基于以下几个原因:

首先,数据驱动的需求。

生活在一个数据爆炸的时代,大量丰富和多样化的数据需要更强大的模型来处理和理解。

大模型具备容纳和处理海量数据的能力,通过大规模的数据训练,能够挖掘出深层次的模式和规律。

其次,计算能力的提升。

硬件技术的不断进步,GPU等高性能计算设备的发展,为大模型的训练提供了强大的算力支持。使得训练大型、复杂的模型成为可能。

再者,追求更高的性能和精度。

大模型通常能够在语言理解、生成、图像识别等多个领域展现出卓越的性能,懂的越多,生成出来的结果也就越准确。

最后,泛化能力更强。

大模型能够更好地处理未曾见过的新问题和新任务,能够基于之前学到的知识进行合理的推测和回答,具有更强的泛化能力。

再加上AI领域竞争激烈,各研究机构和巨头都致力于开发更大更强的模型,展示技术实力和领先地位,卷模型大小自然成了LLM的发展大方向。

Karpathy也将当前最强大模型的规模归因于训练数据的复杂性,并补充说大语言模型在记忆方面表现出色,超越了人类的记忆能力。

类比一下,期末周如果你要接受闭卷考试,考试要求根据前几个单词背诵书本上的某个段落。

这就是当今大模型的预训练目标。Karpathy表示,现在的大模型就像是一个贪吃蛇,只想把所有能用的数据全部吞进肚子里。

它们不仅能背诵常见数字的SHA系列哈算法,还能记住所有领域大大小小的知识。

但是,这种学习方式就像是你为了考试,把整个图书馆和互联网上的内容通通都背下来。

不可否认能做到这种记忆能力的是天才,但是结果考试时只用到了其中的一页!

对于这种天才学生——LLM想要做得更好之所以困难,是因为在训练数据的过程中,思维演示与知识「纠缠」在一起。

而且,一方面从实际应用的角度来看,大模型在部署和运行时面临着高昂的成本和资源消耗,包括计算资源、存储资源以及能源消耗等。

小模型更易于在各种设备和场景中进行部署,满足使用便利性和低功耗的要求。

另一方面,从技术成熟的角度考虑,当通过大模型充分探索和理解了问题的本质和规律后,可以将这些知识和模式提炼并应用于小模型的设计和优化中。

使得小模型在保持大模型同等性能甚至更优性能的前提下,降低规模和成本。

虽然大模型发展遇到了瓶颈,小模型逐渐成为新趋势,但是Karpathy强调,大模型仍然是需要的,即使它们没有得到有效的训练,但是小模型正是从大模型中浓缩而来。

Karpathy预计,每个模型都会不断改进,为下一个模型生成训练数据,直到出现「完美的训练集」。

即使是像GPT-2这样,拥有15亿个参数的已经out模型,当你用这个完美的训练集来训练GPT-2时,它可能会变成一个按今天标准来看非常强大且智能的模型。

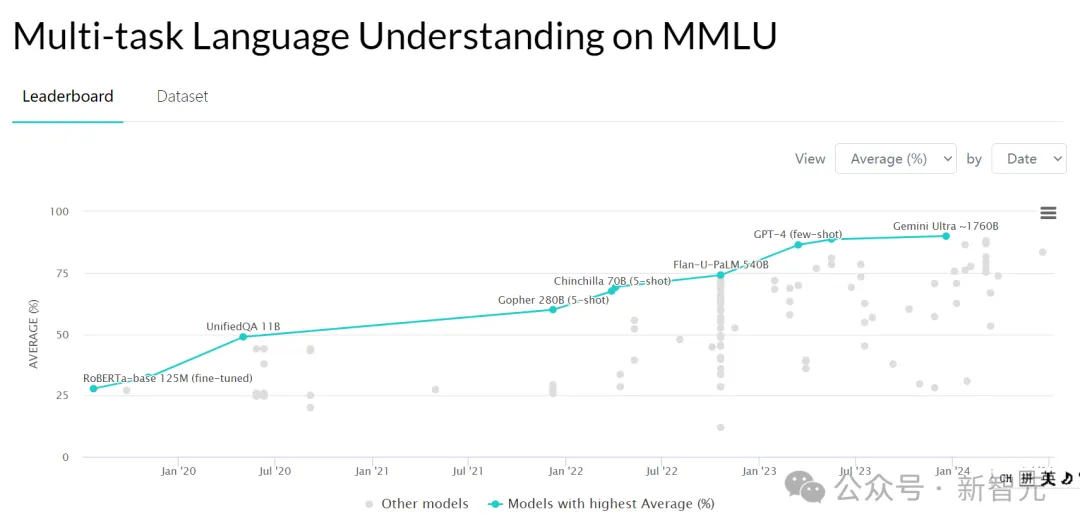

这个用完美的训练集训练过的GPT-2可能在例如大规模多任务语言理解(MMLU)测试中的分数会稍低一些,MMLU测试涵盖57项任务,包括初等数学、美国历史、计算机科学、法律等,用以评测大模型基本的知识覆盖范围和理解能力。

图片

图片

但未来更智能的人工智能模型并不走量取胜,它可以更可靠地检索信息并验证事实。

正如一个学霸做开卷考试,虽然不是所有的知识都烂熟于心,但是能够精准地定位到正确答案。

据报道,OpenAI的Strawberry项目就着重在解决这个问题。

「虚胖」大模型的「瘦身」

正如Karpathy所说,经过海量数据训练出来的超大模型(如GPT-4),大部分其实是用来记住大量的无关紧要细节的,也就是死记硬背资料。

这与模型预训练的目的有关,在预训练阶段,模型被要求尽可能准确的复述接下来的内容,这相当于背课文,背的越准得分越高。

虽然,模型能学会里面反复出现的知识,但是,数据资料有时也会出现错误和偏见,模型还要先全部记住再进行微调。

Karpathy相信如果有更高质量的训练数据集,完全可以训练出一个规模更小,能力更强,更有推理能力的模型。

可以在超大模型的帮助下,自动生成,清洗出质量更高的训练数据集。

类似GPT-4o mini,就是用GPT-4清洗出来的数据训练的。

先把模型做大,然后在此基础上「瘦身」,这可能是一种模型发展的新趋势。

做个生动的比喻就像当前的大模型存在数据集过多虚胖的问题,经过数据清洗和大量训练,摇身一变一身精瘦肌肉的小模型。

这个过程就像是一个阶梯式的进化,每一代模型都会帮助生成下一代的训练数据,直到我们最终得到一个「完美的训练集」。

OpenAI首席执行官Sam Altman也发表了类似言论,早在2023年4月就宣布大型AI模型的「时代结束」。

并且,数据质量是AI训练的关键成功因素也越来越成为共识,无论是真实数据还是合成数据。

奥特曼认为,关键问题是人工智能系统如何从更少的数据中学到更多的东西。

微软研究人员在开发Phi模型时也做出了相同的判断,Hugging Face AI研究人员也同意对于高质量数据集的追求,并发布了高质量的训练数据集。

这意味着一味扩张不再是科技巨头们唯一的技术目标,即使是小型的高质量模型也可以受益于更多、更多样化、更高质量的数据。

回到更小、更高效的模型可以被视为下一个整合阶段的目标,OpenAI的模型发布就清晰地表明未来的发展方向。

评论区:正确的、中肯的、一阵见血的

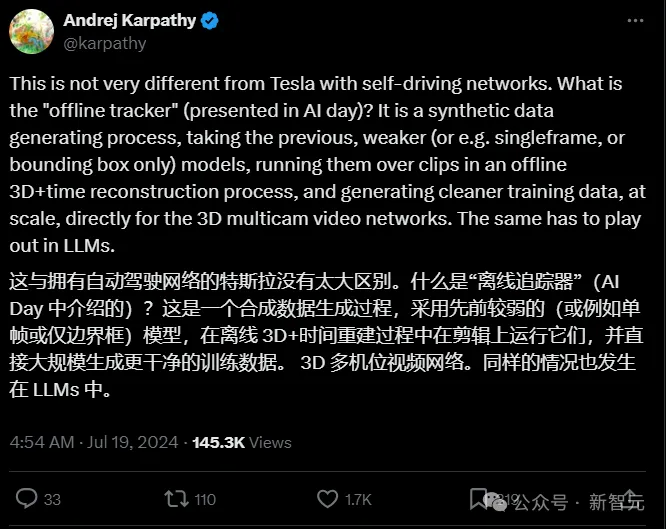

Karpathy还提到了特斯拉在自动驾驶网络上的类似做法。

图片

图片

特斯拉有一个叫「离线追踪器」的东西,通过运行先前的较弱模型,生成更干净的训练数据。

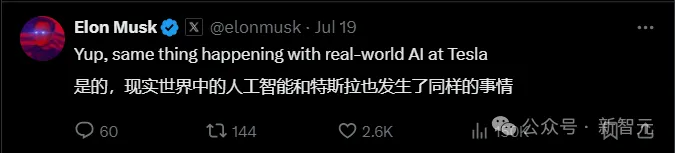

一听到特斯拉技术被cue走在时代前列,马斯克迅速赶往评论区:

图片

图片

评论区的网友对于Karpathy的远见卓识也纷纷表示,臣附议!

对于未来的通用人工智能来说,更小、更高效的人工智能模型可能会重新定义人工智能中的「智能」,挑战「越大越好」的假设。

图片

图片

《Python机器学习》作者Sebastian Raschka认为,这就像是知识蒸馏,从27B的大模型蒸馏出Gemma-2这样的小模型。

他也提醒我们,MMLU这种多选题测试,可以测试知识,但不能完全反映实际能力。

图片

图片

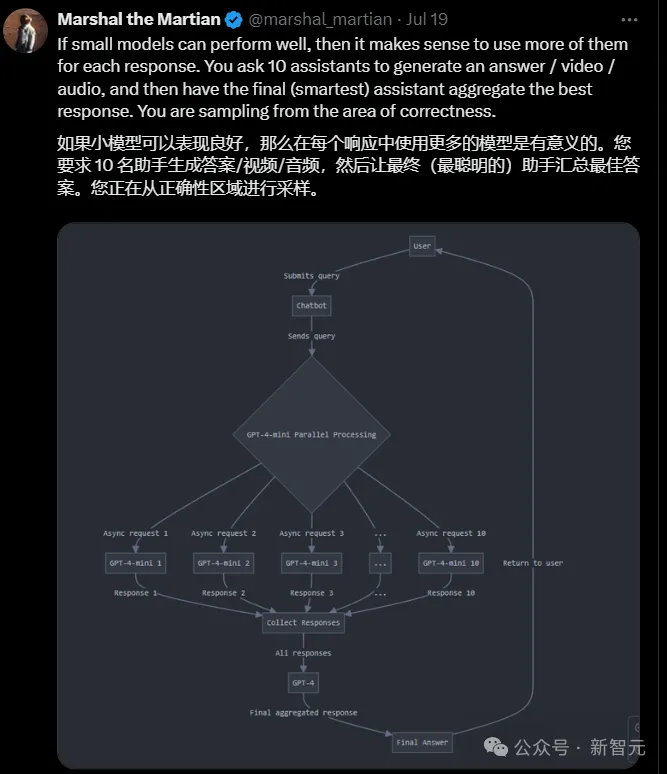

也有网友脑洞大开,如果小模型表现得好,那么术业有专攻,为什么不用更多的小模型来生成一个个回答呢?

召集10个AI助手,然后让最聪明的那个做最后的总结,简直是AI版的智囊团。

图片

图片

那么,AGI到底是一个全能大模型,还是来自许多小模型的协作呢?

参考资料:

https://the-decoder.com/ai-models-might-need-to-scale-down-to-scale-up-again/

https://x.com/karpathy/status/1814038096218083497